Neuer Algorithmus erkennt Deepfake-Videos

Wissenschaftler erzielen fast 100-prozentige Sicherheit mithilfe Künstlicher Intelligenz

|

So veranschaulichen die indischen Forscher ihr System (Grafik: SPIE) |

Patiala/Delhi (pte015/29.07.2020/11:30) Forscher des Thapar Institute of Engineering and Technology http://thapar.edu und des Indraprastha Institute of Information Technology http://iiitd.ac.in haben ein Verfahren entwickelt, das Deepfake-Videos zuverlässig erkennt. Sie nutzen hierzu die gleiche Technik, mit der die Fälschungen hergestellt wurden: Künstliche Intelligenz. Die Erfolgsquote lag bei 98,21 bis 99,62 Prozent - und das bei einer kurzen Trainingszeit.

Erkennung auf zwei Ebenen

Der Algorithmus hat zwei Ebenen für die Erkennung. In der ersten werden Videos leicht bearbeitet, etwa gezoomt. In der zweiten werden zwei Techniken eingesetzt - zunächst ein "Convolutional Neural Network", eine Art faltendes neuronales Netzwerk. Es handelt sich um ein von biologischen Prozessen inspiriertes Konzept im Bereich des Maschinenlernens. Die zweite Technik heißt "Long short-term memory". Diese wird zum Trainieren von künstlichen neuronalen Netzwerken genutzt. Sie merkt sich Fehleinschätzungen und gibt sich erst zufrieden, wenn das richtige Ergebnis vorliegt, also die Entscheidung, ob ein Video echt oder gefälscht ist.

Zunächst mussten die indischen Forscher ihren Algorithmus trainieren. Zu diesem Zweck haben sie einen Datensatz mit 200 Videos ähnlich aussehender Politikerpaare erstellt. 100 davon waren real und die anderen 100 wurden mit Deepfake-Technologie manipuliert. Einen Teil davon kennzeichneten die Entwickler als echt oder gefälscht. Das half dem Algorithmus, eigenständige Entscheidungen zu treffen. Die neue Methode testeten die Forscher an 181.608 Beispielen von echten und gefälschten Videos. Damit haben soziale Medien möglicherweise ein zuverlässiges Instrument, um oft gefährliche Fälschungen zu identifizieren und zu löschen.

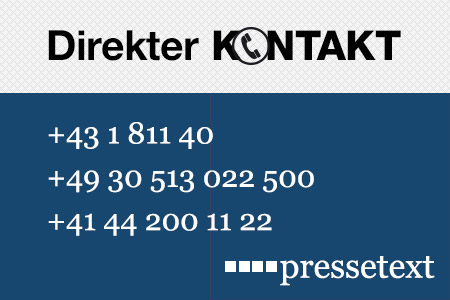

(Ende)| Aussender: | pressetext.redaktion |

| Ansprechpartner: | Wolfgang Kempkens |

| Tel.: | +43-1-81140-300 |

| E-Mail: | kempkens@pressetext.com |

| Website: | www.pressetext.com |