9.000 Prozent mehr Posts vor Ukraine-Invasion

Veränderungen im Social Web weisen laut University of Notre Dame auf politische Ereignisse hin

|

Meme: Posts werden als politische Waffe zur Beeinflussung eingesetzt (Foto: pixabay.com, Enrique) |

Notre Dame (pte021/28.04.2025/11:30)

Forscher der University of Notre Dame nutzen Künstliche Intelligenz (KI) zur Untersuchung visueller Social-Media-Posts in Hochrisikosituationen. Als Beispiel dient den Experten der 2022 gestartete Angriffskrieg Russlands gegen die Ukraine. Laut den Wissenschaftlern Tim Weninger und Ernesto Verdeja stellen Veränderungen der Postings, vor allem jene mit Bildern, einen starken Indikator für kommende Massengewalt dar.

Militär-Blogger extrem aktiv

In den zwei Wochen vor der Invasion kam es zu einem Anstieg der Anzahl der Posts um fast 9.000 Prozent. Die Zahl der manipulierten Bilder von Militär-Bloggern stieg zeitgleich um mehr als 5.000 Prozent. Diese Blogger konzentrieren sich auf bestehende militärische Konflikte. Laut den Forschern zeigt dieser große Anstieg, wie umfassend die Online-Propaganda Russlands war und wie sie bis dato eingesetzt wird, um die Meinung zu beeinflussen und die Invasion zu rechtfertigen.

Die Experten haben die gesamte Historie der Posts und Bilder von den Accounts von 989 russischen Militär-Bloggern auf Telegram unter die Lupe genommen. Dabei handelt es sich um fast sechs Mio. Posts und mehr als drei Mio. Bilder. Jedes Posting und jedes Foto haben die Wissenschaftler für eine genaue Analyse mit einem Zeitstempel versehen und entsprechend kategorisiert.

Memes manipulieren gezielt

Die Forscher hatten bereits zuvor KI-Tools entwickelt, die Veränderungen und Manipulationen von Bildern erkennen. Eines dieser Memes zeigt den gegen Putin eingestellten Journalisten und früheren russischen Soldaten Arkady Babchenko. Sein Tod war vom Sicherheitsdienst der Ukraine vorgetäuscht worden. Das Meme macht ihn zum Charakter eines Videospiels, der nicht stirbt, sondern wieder lebendig wird - nur ein Beispiel für Millionen andere zur strategischen Manipulation.

KI kann Fälschungen zwar gut erkennen, sie versteht jedoch den politischen Kontext nicht, so die Experten. Daher sei eine Zusammenarbeit mit Sozialwissenschaftlern wichtig. Ein gefälschtes Foto des französischen Präsidenten Emmanuel Macron mit dem ukrainischen Gouverneur Vitalii Kim dürfte für die KI bedeutungslos sein. Für menschliche Experten lobt es scheinbar den übergroßen Mut der Ukraine im Gegensatz zu Regierungschefs, die sich vor der nuklearen Bedrohung Russlands fürchten.

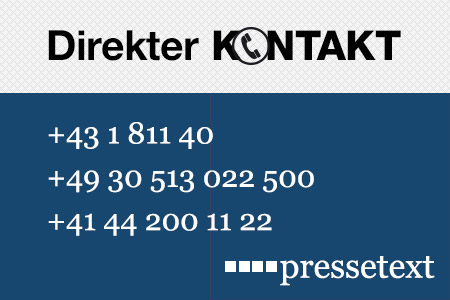

(Ende)| Aussender: | pressetext.redaktion |

| Ansprechpartner: | Moritz Bergmann |

| Tel.: | +43-1-81140-300 |

| E-Mail: | bergmann@pressetext.com |

| Website: | www.pressetext.com |