Pädophile missbrauchen KI für Kinderpornos

Internet Watch Foundation spürt 20.254 KI-Fotos auf einer einzigen Seite im Dark Web auf

|

Kinderpornos: KI verschärft Problematik im Web (Foto: unsplash.com, Stefano Pollio) |

Cambridge (pte010/25.10.2023/11:30)

Pädophile missbrauchen die Möglichkeiten von Künstlicher Intelligenz (KI), um in kurzer Zeit Unmengen von kinderpornografischem Bildmaterial herzustellen. Das zeigt ein aktueller Bericht der Internet Watch Foundation (IWF), der erstmals die Auswirkungen der fortschreitenden KI-Entwicklung auf die Verbreitung von entsprechenden illegalen Inhalten unter die Lupe nimmt. Im Zuge der Analyse wurden 20.254 KI-generierte Bilder gefunden, die auf einer einzigen Seite im Dark Web im Zeitraum von nur einem Monat gepostet wurden.

Produktion wesentlich erleichtert

"Der Fortschritt im Bereich von Computer-Technologien, inklusive jenem von generativer KI, hat enormes Potenzial, unser Leben zu verbessern. Diese Technologien können aber auch leicht missbraucht werden", heißt es im Bericht der IWF. Das Wachstum des Internets, die Verbreitung von Videotelefonie und Live-Streaming sowie die Entwicklung von computergenerierten visuellen Effekten und Bildbearbeitungsprogrammen habe etwa die Produktion und Verbreitung von kinderpornografischem Content wesentlich erleichtert und angefeuert.

Mit dem jüngsten Bericht legt die IWF nun Beweise vor, um auf dieses wachsende neue Problem aufmerksam zu machen. "Die KI-Methode unterscheidet sich von bisherigen Technologien vor allem dadurch, dass es möglich ist, offline eine große Zahl dieser Bilder herzustellen. Diejenigen, die daran arbeiten, sexuellen Missbrauch online zu bekämpfen, können da nicht mithalten", sagen die Experten. Und dabei werde die KI-Entwicklung sicher noch voranschreiten. "Irgendwann werden sich damit auch realistische Videos produzieren lassen. Einzelne Beispiele gibt es bereits", so die IWF.

Täter offline nicht aufspürbar

Für ihre Untersuchung hat die britische Charity-Organisation eigenen Angaben zufolge zwölf Analysten eingesetzt, die 87,5 Stunden lang kinderpornografisches Material auf einschlägigen Seiten im Dark Web sichteten und auswerteten. Im Zuge dessen wurden auf einer einzigen Seite 20.254 KI-generierte Bilder gefunden, wovon 11.108 zur genaueren Analyse herangezogen wurden, weil sie mit hoher Wahrscheinlichkeit Inhalte zeigen, die gegen geltendes Recht verstoßen.

"Die Täter können sich alles, was sie brauchen, um diese Bilder zu generieren, auf legale Weise herunterladen und damit dann so viele Fotos herstellen, wie sie wollen - offline, mit keiner Möglichkeit, sie aufzuspüren", schildert die IWF die Situation. Das habe das Problem auf ein neues Level gehievt: "Wir brauchen dringend Modelle und Tools, um der rasanten Verbreitung dieser Inhalte einen Riegel vorzuschieben."

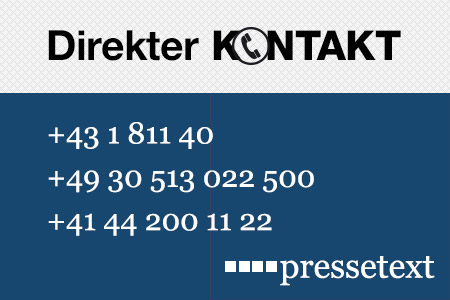

(Ende)| Aussender: | pressetext.redaktion |

| Ansprechpartner: | Markus Steiner |

| Tel.: | +43-1-81140-314 |

| E-Mail: | steiner@pressetext.com |

| Website: | www.pressetext.com |