Neuronales Netz erkennt Emotionen in Fotos

System von Samsung AI und Imperial College London erzielt "bislang ungeahnte Genauigkeit"

|

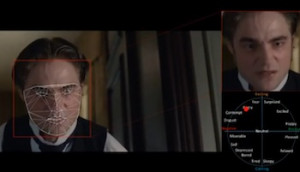

Vollautomatische Emotions-Analyse (Foto: youtube.com, Samsung AI) |

London/Seoul (pte002/28.01.2021/06:05)

Forscher von Samsung AI http://bit.ly/3pn6M3p und dem Imperial College London http://imperial.ac.uk haben ein System entwickelt, das den emotionalen Status eines Menschen auf einem Foto seines Gesichts erkennen kann. Möglich wird das mithilfe eines speziellen selbstlernenden neuronalen Netzwerks, das selbst subtile Charakteristiken von positiven und negativen Emotionen in Echtzeit analysiert. Bei ersten Praxistests erzielte das System eine „bislang ungeahnte Genauigkeit“, die auch von menschlichen Experten nicht übertroffen werden kann, so seine Erfinder.

[b]Valenz und Erregung[/b]

„Wir arbeiten nun schon sehr lange an dem Problem der Erkennung von Gemütszuständen. Dabei ist uns klar geworden, dass es grundsätzlich nicht ausreicht, nur einige wenige Emotionen zu definieren, um die ganze Brandbreite an Affekten einfangen zu können, die der Mensch tagtäglich mit seinem Gesicht ausdrückt“, zitiert „TechXplore“ die Wissenschaftler, die ihren Ansatz in der aktuellen Ausgabe von „Nature Machine Intelligence“ präsentieren. Deshalb habe man sich im neuesten Projekt vor allem auf zwei Dimensionen konzentriert: die Valenz und die Erregung.

Valenz ist dabei ein Begriff, der aus der Psychologie kommt, und quasi allgemein bestimmt, ob jemand gerade eine positive oder negative Gemütsregung durchlebt. Die Erregung gibt an, wie ruhig oder aufgeregt eine Person ist. „Unser Ziel ist es, rein aufgrund eines Fotos des Gesichts eines Menschen automatisch eine verlässliche Aussagen über seine Valenz- und Erregungswerte treffen zu können“, erklären die Experten.

[b]Deep-Learning-Technologie[/b]

Um diese Vorgabe erreichen zu können, haben die Forscher nach der Deep-Learning-Methode ein künstliches neuronales Netzwerk entwickelt und dieses ein intensives Training mit einem riesigen Datensatz von Personenfotos absolvieren lassen. Bei diesen achteten sie besonders darauf, dass die Bilder aus dem normale Alltag der Menschen stammen. „Es hat sich gezeigt, dass es besser ist, Fotos zu verwenden, die einfach im Alltag gemacht wurden und nicht in einem Studio, wenn man eine Technik haben will, die auch im Alltag gut funktioniert“, stellen die Forscher klar.

Bei ersten Testläufen gelang es der Deep-Learning-Technologie sowohl die Valenz als auch die Erregung auf Fotos mit Gesichtern mit „bislang ungeahnter Genauigkeit“ festzustellen, schildern die Wissenschaftler. Die Qualität der Analyseergebnisse sei dabei in etwa gleich einzuschätzen wie bei einem menschlichen Experten, der versucht, die Emotionen der abgebildeten Personen richtig zu deuten. „Als nächstes wollen wir unser System weiterentwickeln, damit es nicht nur bei statischen Bildern, sondern auch bei Videos funktioniert“, verraten seine Erfinder.

(Ende)

| Aussender: | pressetext.redaktion |

| Ansprechpartner: | Markus Steiner |

| Tel.: | +43-1-81140-314 |

| E-Mail: | steiner@pressetext.com |

| Website: | www.pressetext.com |